Luật AI Việt Nam 2026: Marketing tích hợp với AI cần bộ khung để phát triển bền vững

Luật Trí tuệ nhân tạo chính thức có hiệu lực không chỉ là một văn bản pháp lý, mà còn là “kim chỉ nam” cho mọi chiến lược tăng trưởng dựa trên công nghệ.

Nếu năm 2023-2025 là giai đoạn “thử nghiệm và khám phá” của Trí tuệ nhân tạo (AI) tại Việt Nam, nơi các doanh nghiệp mặc sức thử nghiệm và bứt phá, thì ngày 01/03/2026 sẽ đánh dấu một bước ngoặt lịch sử: Kỷ nguyên của sự tuân thủ bắt đầu. Luật Trí tuệ nhân tạo chính thức có hiệu lực không chỉ là một văn bản pháp lý, mà còn là “kim chỉ nam” cho mọi chiến lược tăng trưởng dựa trên công nghệ.

Bài viết thể hiện quan điểm của tác giả Hồ Đông Thụ là Founder & CEO của Think Group – Integrated Communications & Tech Company. Với kinh nghiệm nhiều năm trong lĩnh vực Marketing và Công nghệ và theo đuổi quan điểm kết hợp sự sáng tạo của con người với khả năng của AI một cách có trách nhiệm.

Ứng dụng AI không còn là “thử nghiệm, khám phá”

Trong bối cảnh AI đang len lỏi vào từng ngóc ngách của hoạt động Marketing, từ việc tối ưu hóa nội dung, cá nhân hóa trải nghiệm khách hàng đến tự động hóa quy trình vận hành, câu hỏi đặt ra cho các nhà quản lý không còn là “Dùng AI hay không?” mà là “Dùng AI như thế nào để không vi phạm pháp luật và đảm bảo tính bền vững”

Ảnh minh họa. Nguồn Internet

Luật Trí tuệ nhân tạo (Luật số 134/2025/QH15) ra đời trong bối cảnh Việt Nam đang khát khao khẳng định chủ quyền số và xây dựng một nền kinh tế tri thức bền vững. Đối với cộng đồng doanh nghiệp và đặc biệt là những người làm Marketing, việc thấu hiểu đạo luật này không chỉ để “tránh phạt”, mà còn để xây dựng niềm tin (Trust) – tài sản quý giá nhất của thương hiệu trong kỷ nguyên số.

Bài viết này, dựa trên tài liệu tổng hợp của tác giả Hồ Đông Thụ (CEO Think Group), sẽ bóc tách những điểm cốt lõi nhất của Luật AI Việt Nam mà mọi nhà quản lý cần nằm lòng trước thềm hiệu lực vào tháng 3/2026.

Phần 1: Tổng quan về Luật AI – Triết lý “Quản lý để phát triển”

Luật Trí tuệ nhân tạo Việt Nam gồm 35 điều, được thiết kế theo mô hình tiên phong, học hỏi từ các khung pháp lý quốc tế (như EU AI Act) nhưng được tinh chỉnh để phù hợp với đặc thù kinh tế số tại Việt Nam.

Điểm khác biệt lớn nhất trong tư duy làm luật lần này chính là triết lý “Quản lý để phát triển”. Thay vì tạo ra những rào cản hành chính khô khan, Luật tập trung vào việc tạo ra một hệ sinh thái an toàn, nơi sự đổi mới sáng tạo được khuyến khích trong một “hành lang” có kiểm soát.

Ba mục tiêu cốt lõi mà doanh nghiệp cần lưu ý:

Thúc đẩy đổi mới: Tạo điều kiện cho các doanh nghiệp Tech-driven phát triển các giải pháp AI “Made in Vietnam”.

Bảo vệ quyền con người: Đảm bảo AI không trở thành công cụ xâm phạm quyền riêng tư, định kiến hay thao túng tâm lý người dùng.

An ninh quốc gia & Chủ quyền số: Kiểm soát dòng chảy dữ liệu và sự minh bạch của các thuật toán tác động đến xã hội.

Luật được xây dựng với nguyên tắc lấy con người làm trung tâm, bảo đảm trí tuệ nhân tạo được phát triển và ứng dụng an toàn, minh bạch, có trách nhiệm, vì lợi ích của con người.” Nguồn: Báo Điện Biên Phủ, “Luật Trí tuệ nhân tạo được xây dựng với nguyên tắc lấy con người làm trung tâm”

Ảnh minh họa. Nguồn Pexels

Việc nắm vững luật từ sớm giúp doanh nghiệp chủ động trong khâu R&D và Marketing, tránh được những tổn thất khổng lồ về chi phí và danh tiếng nếu phải thay đổi hệ thống khi luật đã thực thi.

Phần 2: Các nguyên tắc cốt lõi – Nền tảng của “Đạo đức số”

Để vận hành AI một cách “chuẩn bài”, doanh nghiệp cần soi chiếu mọi hoạt động của mình qua 7 nguyên tắc cốt lõi được quy định trong Luật. Đây cũng chính là những chuẩn mực đạo đức mới mà khách hàng sẽ dùng để đánh giá một thương hiệu:

Lấy con người làm trung tâm: AI phải phục vụ lợi ích và sự phát triển của con người, không được thay thế quyền tự quyết của cá nhân.

An toàn và Bảo mật: Hệ thống AI phải có khả năng chống lại các cuộc tấn công và bảo vệ dữ liệu người dùng ở mức cao nhất.

Tính minh bạch và Giải thích được: Đây là “điểm nóng” cho Marketers. Khi sử dụng AI để đưa ra quyết định (ví dụ: duyệt khoản vay, gợi ý giá cá nhân hóa), doanh nghiệp phải có khả năng giải thích logic đằng sau đó cho khách hàng.

Công bằng và Không phân biệt đối xử: Loại bỏ các định kiến về giới tính, vùng miền, sắc tộc trong dữ liệu đầu vào và thuật toán.

Trách nhiệm giải trình: Doanh nghiệp sở hữu hoặc vận hành AI phải chịu trách nhiệm cuối cùng về các hệ quả do AI gây ra.

Phát triển bền vững: Khuyến khích các giải pháp AI tiết kiệm năng lượng và thân thiện với môi trường.

Quản trị dựa trên rủi ro: Đây là xương sống của toàn bộ đạo luật, phân loại AI để có mức độ kiểm soát tương ứng (sẽ được phân tích sâu ở phần sau).

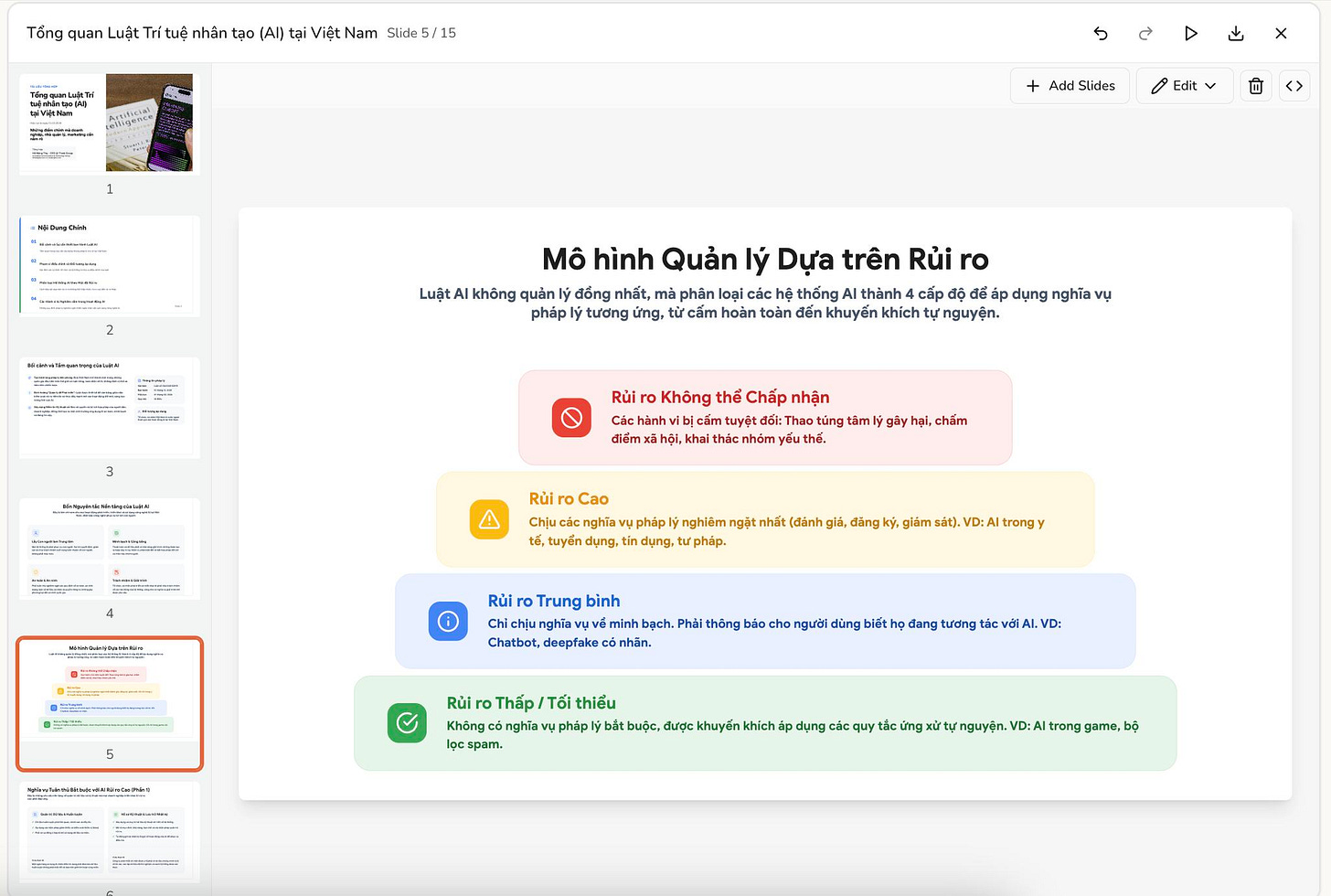

Phân loại Hệ thống AI theo Mức độ Rủi ro

Một trong những điểm cốt lõi của Luật là cách tiếp cận quản lý dựa trên rủi ro. Các hệ thống AI được phân thành 3 nhóm chính, áp dụng các nghĩa vụ pháp lý khác nhau:

Hệ thống AI rủi ro cao: Là các hệ thống có khả năng tác động trực tiếp đến các quyền và lợi ích hợp pháp của con người, an ninh quốc gia, và các lĩnh vực thiết yếu. Danh mục này bao gồm AI trong y tế, giáo dục, tài chính, tư pháp, giao thông, tuyển dụng. Các hệ thống này phải tuân thủ các nghĩa vụ nghiêm ngặt như đánh giá tác động, đăng ký, kiểm định độc lập và đảm bảo sự giám sát của con người.

Hệ thống AI rủi ro trung bình: Các hệ thống này chịu các nghĩa vụ về minh bạch, yêu cầu phải thông báo cho người dùng biết họ đang tương tác với một hệ thống AI.

Hệ thống AI rủi ro thấp: Các hệ thống này được khuyến khích tuân thủ các bộ quy tắc ứng xử tự nguyện mà không có các nghĩa vụ pháp lý bắt buộc, nhằm tạo không gian tối đa cho sự sáng tạo.

Các vùng Quản trị rủi ro khi sử dụng AI – Doanh nghiệp của bạn đang ở “vùng” nào?

Luật AI Việt Nam không đánh đồng mọi hệ thống AI như nhau. Thay vào đó, Luật áp dụng phương pháp “Quản trị dựa trên rủi ro”. Việc hiểu rõ hệ thống AI mà doanh nghiệp đang phát triển hoặc sử dụng thuộc nhóm nào là bước đi đầu tiên để tránh những rắc rối pháp lý không đáng có.

Dựa trên nội dung Luật, có 4 cấp độ rủi ro chính:

Rủi ro không thể chấp nhận được (Unacceptable Risk): Đây là các hệ thống bị CẤM TUYỆT ĐỐI. Ví dụ: Các ứng dụng chấm điểm xã hội (Social Scoring) dựa trên hành vi, hoặc các kỹ thuật thao túng tâm lý tiềm thức nhằm làm thay đổi hành vi gây hại cho cá nhân.

Rủi ro cao (High Risk): Các hệ thống tác động trực tiếp đến an toàn, sức khỏe hoặc quyền cơ bản của con người (như tuyển dụng, chấm điểm tín dụng, định danh sinh trắc học). Nhóm này chịu sự giám sát nghiêm ngặt nhất với các yêu cầu về dữ liệu đầu vào và hồ sơ kỹ thuật.

Rủi ro hạn chế (Limited Risk): Nhóm này phổ biến trong Marketing, bao gồm Chatbots, hệ thống tạo nội dung (Generative AI). Yêu cầu cốt lõi ở đây là Tính minh bạch – người dùng phải được biết họ đang tương tác với AI.

Rủi ro thấp hoặc không đáng kể (Minimal Risk): Các bộ lọc spam, trò chơi điện tử tích hợp AI... Nhóm này được khuyến khích áp dụng các bộ quy tắc ứng xử tự nguyện.

Ảnh minh họa. Nguồn: Biên soạn của tác giả

Lưu ý cho doanh nghiệp: Đa phần các công cụ MarTech hiện nay nằm ở nhóm rủi ro “Hạn chế” và “Thấp”. Tuy nhiên, nếu bạn dùng AI để phân loại khách hàng nhằm mục đích chấm điểm tín dụng hoặc phê duyệt bảo hiểm, bạn đã bước chân vào vùng “Rủi ro cao”.

Phần 4: Những “lằn ranh đỏ” trong hoạt động AI

Để bảo vệ quyền lợi người tiêu dùng, Luật AI 2026 quy định rất rõ những hành vi bị nghiêm cấm. Đối với những người làm Marketing, có 3 điểm cần đặc biệt lưu tâm:

Cấm thao túng tâm lý: Nghiêm cấm sử dụng AI để khai thác điểm yếu của một nhóm người cụ thể (do tuổi tác, khuyết tật, hoặc hoàn cảnh kinh tế) nhằm làm biến dạng hành vi của họ, dẫn đến tổn thương về thể chất hoặc tâm lý.

Cấm phân biệt đối xử từ thuật toán: AI không được phép tạo ra các kết quả dẫn đến sự phân biệt đối xử về giới tính, sắc tộc hay tôn giáo trong việc tiếp cận các dịch vụ, ưu đãi.

Cấm sử dụng dữ liệu sinh trắc học trái phép: Việc thu thập và phân tích cảm xúc, khuôn mặt tại các điểm bán lẻ (Retail) mà không có sự đồng ý minh bạch của khách hàng sẽ đối mặt với chế tài nặng nề.

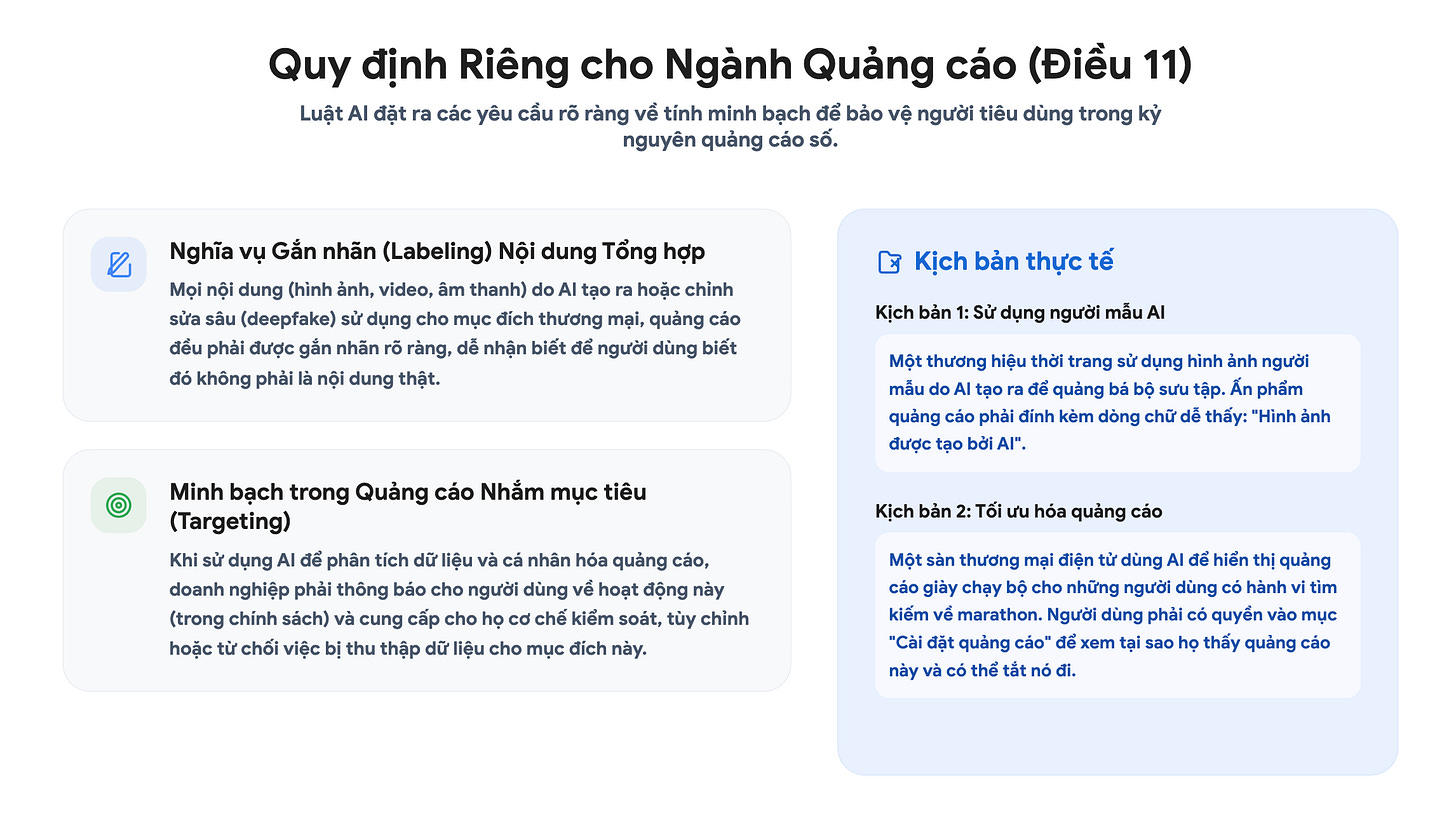

Phần 5: Checklist tuân thủ dành riêng cho lĩnh vực Marketing & Quảng cáo

Ảnh minh họa. Nguồn: Biên soạn của tác giả

Để sẵn sàng cho cột mốc 01/03/2026 này, các CMO và Agency cần bắt đầu rà soát theo danh sách thực thi sau:

1. Rà soát tài sản dữ liệu (Data Audit)

Kiểm tra nguồn gốc dữ liệu dùng để huấn luyện AI hoặc chạy quảng cáo cá nhân hóa. Đảm bảo dữ liệu được thu thập hợp pháp và có sự đồng ý của người dùng (Consent).

Thiết lập quy trình loại bỏ các định kiến (bias) trong dữ liệu để tránh các rủi ro về phân biệt đối xử trong chiến dịch.

2. Minh bạch hóa nội dung AI (Content Labeling)

Gắn nhãn nội dung: Mọi hình ảnh, video, văn bản được tạo ra bởi Generative AI trong các chiến dịch truyền thông phải có dấu hiệu nhận biết rõ ràng cho khách hàng (ví dụ: “Hình ảnh được tạo bởi AI”).

Thông báo tương tác: Nếu doanh nghiệp sử dụng AI Chatbot để chăm sóc khách hàng, phải có thông báo ngay từ đầu: “Bạn đang trò chuyện với trợ lý ảo của chúng tôi”.

3. Kiểm soát Deepfake và Bản quyền sáng tạo

Khi sử dụng hình ảnh/giọng nói của người nổi tiếng (KOLs) được tái tạo bằng AI, phải có thỏa thuận văn bản rõ ràng về phạm vi sử dụng và quyền sở hữu trí tuệ.

Đảm bảo các tác phẩm quảng cáo do AI tạo ra không vi phạm bản quyền của bên thứ ba.

4. Đánh giá tác động hệ thống (Algorithmic Impact Assessment)

Với các chiến dịch sử dụng AI để phân loại và nhắm mục tiêu (Targeting) sâu, hãy thực hiện đánh giá xem thuật toán có đang “vô tình” gây ra các hệ quả tiêu cực cho người tiêu dùng hay không.

Lưu trữ hồ sơ kỹ thuật về cách thuật toán hoạt động để sẵn sàng giải trình khi có yêu cầu từ cơ quan chức năng.

5. Đào tạo đội ngũ (Internal Training)

Cập nhật kiến thức Luật AI 2026 cho đội ngũ Creative và Media. Sáng tạo là tự do, nhưng phải nằm trong khuôn khổ đạo đức và pháp lý.

Lời kết: Đi nhanh nhờ “phanh” tốt

Nhiều doanh nghiệp lo ngại pháp lý sẽ làm chậm tốc độ đổi mới. Tuy nhiên, nhìn từ góc độ bền vững, Luật AI chính là bộ “phanh” giúp chiếc xe doanh nghiệp chạy nhanh hơn mà không lo lật bánh ở những khúc cua nghiệt ngã của công nghệ.

Việc tuân thủ Luật AI 2026 không chỉ là nhiệm vụ của bộ phận Pháp lý (Legal), mà là trách nhiệm của mỗi Marketer. Hãy biến sự tuân thủ thành một lợi thế cạnh tranh, khẳng định vị thế của một thương hiệu nhân văn và trách nhiệm trong mắt người tiêu dùng Việt.

[Bonus] TÀI LIỆU 20 TRANGEBOOK VÀ 15 SLIDES TỔNG HỢP LUẬT AI VIỆT NAM dành cho Nhà quản lý, quản trị tuân thủ và các marketer.

Download tại: https://drive.google.com/drive/folders/19a2Bip7skso-k0guJNutBBeLEe7ShmkO?usp=sharing

Một số tài liệu và văn bản bổ sung.

A - Văn Bản & Định Hướng Của Chính Phủ

Đây là những tài liệu nền tảng, định hình khung pháp lý cho AI tại Việt Nam trong tương lai.

Quyết định 127/QĐ-TTg về Chiến lược quốc gia về AI

Văn bản phê duyệt “Chiến lược quốc gia về nghiên cứu, phát triển và ứng dụng Trí tuệ nhân tạo đến năm 2030”. Đây là văn bản định hướng quan trọng nhất, đặt mục tiêu đưa Việt Nam vào nhóm dẫn đầu ASEAN về AI.

Xem chi tiết tại Cổng TTĐT Chính phủ

Dự thảo Luật Trí tuệ nhân tạo

Bản dự thảo Luật AI đang được Bộ Khoa học và Công nghệ lấy ý kiến. Nội dung cốt lõi của dự thảo là quản lý AI dựa trên 4 cấp độ rủi ro: Không chấp nhận được, Rủi ro cao, Rủi ro trung bình, và Rủi ro thấp.

Xem trên Báo Điện tử Chính phủ

Xem bản cập nhật tại LuatVietnam

B. Các Bài Viết, Phân Tích và Bình Luận

Quốc hội thông qua Luật Trí tuệ nhân tạo: Hoàn thiện hành lang pháp lý cho kỷ nguyên số

Nguồn: Cổng TTĐT Bộ Khoa học và Công nghệ

Luật Trí tuệ nhân tạo đặt nền tảng cho tự chủ AI

Nguồn: Báo Công Thương

Xem bài viết

Luật Trí tuệ nhân tạo 2025 và 10+ điểm đáng chú ý

Nguồn: LuatVietnam

Xem bài viết